Kontakt - Quick load

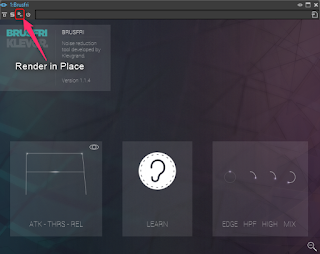

Kto nie czyta instrukcji, ten tak ma Używam samplera Kontakt od lat. Uzbierałem przez ten czas mnóstwo bibliotek dźwiękowych i to nie tylko tych "standardowych", które można aktywować poprzez Native Access i zobaczyć ich graficzne wizytówki: Wiele bibliotek, zwłaszcza tanich lub darmowych, nie posiada wygodnego panelu i trzeba się do nich dostawać za pomocą zakładki Files : Jest to średnio wygodne, zwłaszcza - jak w moim przypadku - trzyma się biblioteki rozdzielone na różnych dyskach. Wówczas odszukanie rzadziej używanego instrumentu bywa frustrujące, bo trzeba systematycznie przewertować poszczególne foldery w poszukiwaniu plików nki , zaś funkcja wyszukiwania/filtrowania nie do końca się sprawdza, bo możemy nie pamiętać dokładnej nazwy. Do tej pory jakoś się z tym męczyłem, ale podczas oglądania jakiegoś samouczka na YouTube zauważyłem, że prowadzący ma jakiś fajny panel, z którego wczytuje sobie instrumenty. Chwilę poszperałem i... no, teraz też mam ten panel i o...